KI Fußball xG Analyse statistisch: Die mathematischen Grundlagen der Spielbewertung

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Wer die xG-Analyse wirklich verstehen will, kommt an den statistischen Grundlagen nicht vorbei. Die Zahlen, die auf den Bildschirmen erscheinen, sind das Ergebnis mathematischer Verfahren, deren Logik nachvollziehbar ist, wenn man bereit ist, sich mit ihnen auseinanderzusetzen. Dieses Verständnis ist keine akademische Spielerei, sondern die Voraussetzung für eine kritische und effektive Nutzung der Metrik.

Die gute Nachricht lautet: Man muss kein Mathematikstudium absolviert haben, um die wesentlichen Konzepte zu begreifen. Die statistischen Prinzipien, die der xG-Analyse zugrunde liegen, lassen sich anschaulich erklären und auf den Fußball übertragen. Die Mühe lohnt sich, denn wer die Grundlagen versteht, kann die Daten selbstständig interpretieren und muss sich nicht blind auf die Einschätzungen anderer verlassen.

Dieser Artikel führt durch die statistischen Konzepte, die für die xG-Analyse relevant sind. Er erklärt, warum Stichprobengrößen wichtig sind, wie Wahrscheinlichkeitsverteilungen funktionieren und was die Regression zum Mittelwert für die Prognose bedeutet. Am Ende steht ein Verständnis, das über das oberflächliche Ablesen von Werten hinausgeht und eine fundierte Einschätzung ermöglicht.

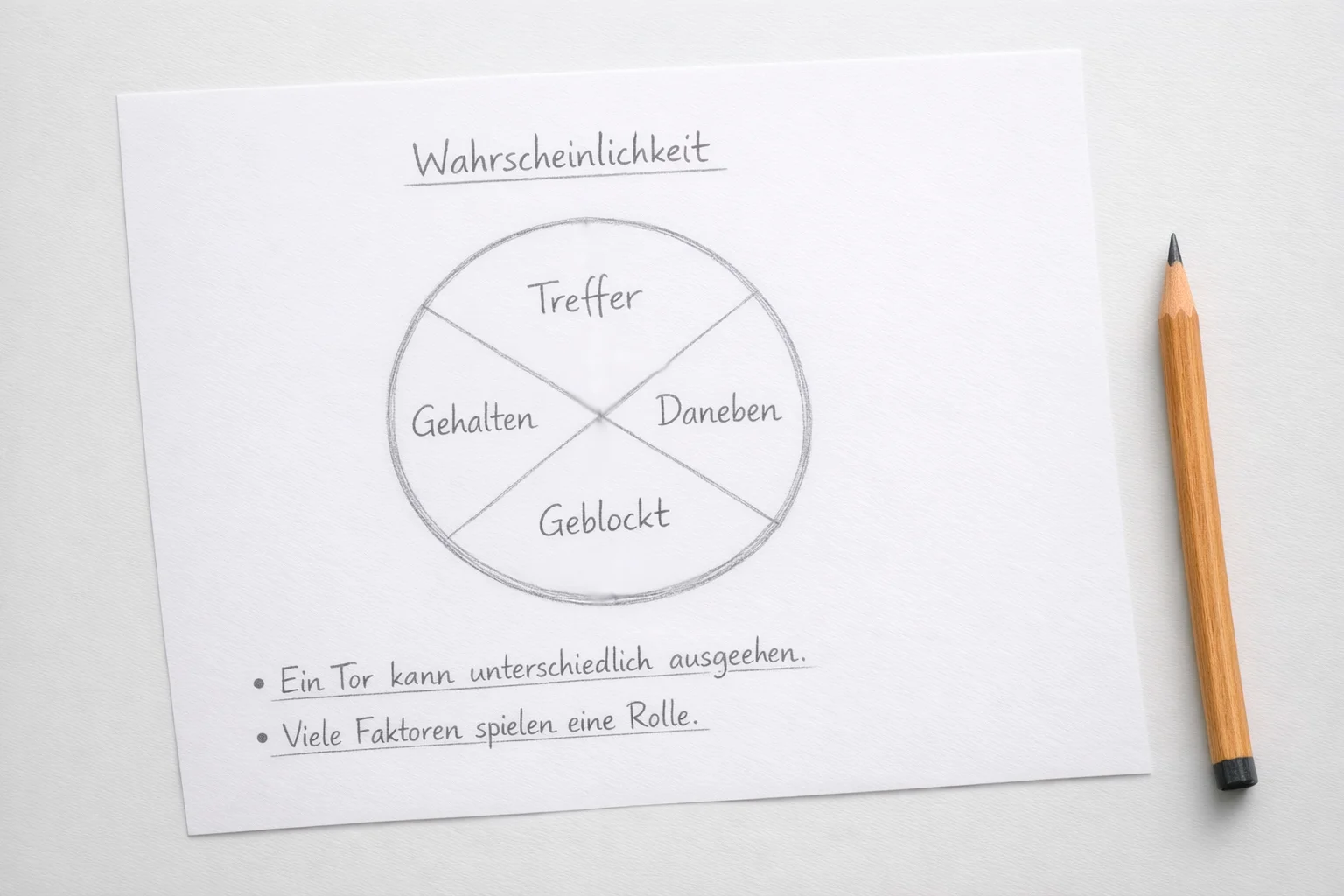

Wahrscheinlichkeit als Grundkonzept

Die xG-Metrik ist im Kern eine Wahrscheinlichkeitsaussage. Wenn ein Schuss einen xG-Wert von 0,25 hat, bedeutet das, dass ein durchschnittlicher Spieler aus dieser Position in 25 Prozent der Fälle treffen würde. Diese Aussage bezieht sich nicht auf den konkreten Schuss, sondern auf eine hypothetische Gesamtheit von ähnlichen Situationen.

Das Konzept der Wahrscheinlichkeit ist intuitiv verständlich, birgt aber Tücken, die oft übersehen werden. Ein xG von 0,25 bedeutet nicht, dass der Spieler versagt hat, wenn er nicht trifft. Es bedeutet auch nicht, dass er Glück hatte, wenn er trifft. Es bedeutet lediglich, dass diese Art von Chance statistisch gesehen in einem Viertel der Fälle zum Tor führt. Der einzelne Ausgang ist damit vereinbar, unabhängig davon, ob das Tor fällt oder nicht.

Die Aggregation von Wahrscheinlichkeiten über mehrere Ereignisse führt zu aussagekräftigeren Aussagen. Wenn ein Spieler im Laufe einer Saison Chancen im Gesamtwert von 15 xG bekommt, erwarten wir, dass er ungefähr 15 Tore erzielt. Erzielt er deutlich mehr oder weniger, weicht er vom statistischen Mittel ab, was Fragen aufwirft, die untersucht werden sollten.

Die Unabhängigkeit der Ereignisse ist eine wichtige Annahme, die nicht immer erfüllt ist. Das xG-Modell behandelt jeden Schuss als unabhängig von den vorherigen, aber in der Realität können psychologische Faktoren diese Unabhängigkeit verletzen. Ein Stürmer, der gerade eine Großchance vergeben hat, steht möglicherweise unter größerem Druck beim nächsten Abschluss. Diese Effekte sind schwer zu quantifizieren und werden von den Modellen in der Regel ignoriert.

Stichprobengröße und Aussagekraft

Eines der am häufigsten missverstandenen Konzepte in der Fußballstatistik betrifft die Stichprobengröße. Die Frage, wie viele Datenpunkte benötigt werden, um eine verlässliche Aussage zu treffen, ist entscheidend für die Interpretation von xG-Werten.

Ein einzelnes Spiel liefert eine sehr kleine Stichprobe. Ein Team hat vielleicht zehn Torschüsse, von denen zwei oder drei als hochkarätig gelten. Die Summe dieser Chancen ergibt einen xG-Wert, der aber mit erheblicher Unsicherheit behaftet ist. Die Varianz von Spiel zu Spiel ist so hoch, dass Rückschlüsse auf die wahre Stärke eines Teams praktisch unmöglich sind.

Mit zunehmender Anzahl von Spielen wird die Aussage verlässlicher. Nach fünf Spieltagen haben wir mehr Datenpunkte, nach zehn noch mehr, und nach einer kompletten Saison ist die Stichprobe groß genug, um fundierte Schlüsse zu ziehen. Die Faustformel besagt, dass xG-Werte erst nach etwa zehn bis fünfzehn Spielen, manchmal sogar erst nach einer halben Saison, als verlässlich gelten können.

Die statistische Signifikanz ist ein formales Konzept, das diese Intuition präzisiert. Eine Abweichung zwischen tatsächlichen Toren und xG-Wert ist signifikant, wenn sie mit hoher Wahrscheinlichkeit nicht durch Zufall erklärt werden kann. Die genaue Berechnung erfordert statistische Tests, aber als Daumenregel gilt: Je größer die Stichprobe und je größer die Abweichung, desto wahrscheinlicher ist ein echter Effekt.

Die praktische Konsequenz ist klar: Vorsicht bei Aussagen nach wenigen Spielen. Wenn ein Team nach drei Spieltagen einen hohen xG-Wert hat, ist das interessant, aber nicht aussagekräftig. Erst über längere Zeiträume stabilisieren sich die Werte und ermöglichen verlässliche Einschätzungen.

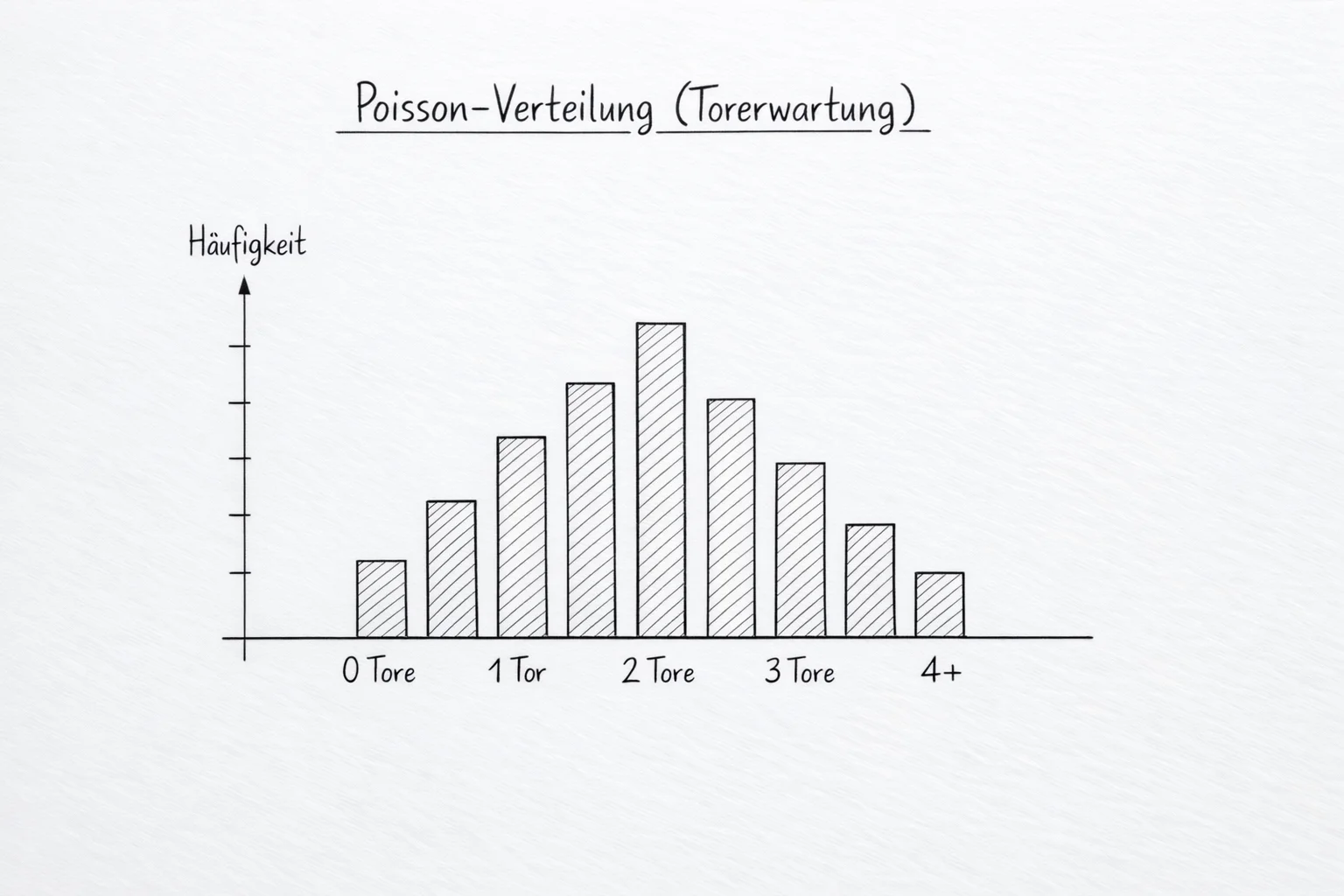

Die Poisson-Verteilung in der Torerwartung

Die Poisson-Verteilung ist ein mathematisches Modell, das die Verteilung von seltenen Ereignissen beschreibt. Tore im Fußball sind solche seltenen Ereignisse, und die Poisson-Verteilung eignet sich daher gut, um die Wahrscheinlichkeit verschiedener Spielausgänge zu berechnen.

Die Grundidee ist einfach: Wenn wir den erwarteten Wert kennen, können wir die Wahrscheinlichkeit für jede mögliche Anzahl von Toren berechnen. Ein Team mit einem xG von 1,5 wird nicht in jedem Spiel exakt 1,5 Tore schießen, denn Tore sind ganzzahlig. Stattdessen wird es manchmal null Tore schießen, manchmal eins, manchmal zwei, und gelegentlich drei oder mehr. Die Poisson-Verteilung gibt an, wie wahrscheinlich jede dieser Möglichkeiten ist.

Für ein Team mit xG 1,5 ergibt die Poisson-Verteilung ungefähr folgende Wahrscheinlichkeiten: null Tore in etwa 22 Prozent der Fälle, ein Tor in etwa 33 Prozent, zwei Tore in etwa 25 Prozent, drei Tore in etwa 13 Prozent, und vier oder mehr Tore in den restlichen sieben Prozent. Diese Verteilung lässt sich nutzen, um die Wahrscheinlichkeit verschiedener Spielausgänge zu berechnen.

Die Kombination der Poisson-Verteilungen beider Teams ermöglicht die Berechnung von Siegwahrscheinlichkeiten. Wenn Team A einen xG von 1,5 hat und Team B einen xG von 1,0, können wir für jede mögliche Kombination von Torergebnissen die Wahrscheinlichkeit berechnen und daraus ableiten, wie wahrscheinlich ein Heimsieg, ein Unentschieden oder ein Auswärtssieg ist.

Die Poisson-Verteilung ist ein vereinfachendes Modell, das nicht alle Aspekte des Fußballs erfasst. Sie unterstellt beispielsweise, dass die Torerzielung der beiden Teams unabhängig voneinander ist, was nicht immer zutrifft. Wenn ein Team früh in Führung geht, ändert sich die Spielweise beider Mannschaften, und die ursprünglichen xG-Erwartungen sind möglicherweise nicht mehr gültig. Trotz dieser Einschränkungen liefert die Poisson-Verteilung eine nützliche erste Annäherung.

Varianz und ihre Bedeutung

Die Varianz ist ein Maß dafür, wie stark die einzelnen Werte um den Mittelwert streuen. Im Kontext der xG-Analyse ist sie entscheidend, weil sie die Unsicherheit quantifiziert, die jeder Prognose innewohnt.

Ein Team mit einem durchschnittlichen xG von 1,5 pro Spiel wird nicht in jedem Spiel exakt diesen Wert erreichen. In manchen Spielen kreiert es kaum Chancen und hat einen xG von 0,5, in anderen dominiert es den Gegner und erreicht 3,0. Diese Schwankungen sind normal und spiegeln die inhärente Variabilität des Fußballs wider.

Die Varianz zwischen verschiedenen Spielen ist erheblich und wird oft unterschätzt. Selbst konstante Teams zeigen von Woche zu Woche unterschiedliche xG-Werte, weil die Spielumstände variieren. Die Stärke des Gegners, die taktische Ausrichtung, individuelle Tagesformen und der Spielverlauf beeinflussen die Chancenkreation auf Weisen, die nicht vollständig vorhersehbar sind.

Die Konsequenz für die Analyse ist, dass einzelne Spiele mit Vorsicht interpretiert werden müssen. Ein ungewöhnlich hoher oder niedriger xG-Wert kann ein Ausreißer sein, der nichts über die wahre Stärke des Teams aussagt. Erst die Betrachtung über mehrere Spiele hinweg glättet diese Schwankungen und liefert ein verlässlicheres Bild.

Die Unterscheidung zwischen Varianz und Trend ist eine der schwierigsten Aufgaben der Fußballanalyse. Wenn ein Team in drei aufeinanderfolgenden Spielen niedrige xG-Werte hat, kann das ein Zeichen für eine echte Schwäche sein, aber es kann auch einfach eine zufällige Häufung sein. Die statistische Analyse hilft, diese Fälle zu unterscheiden, aber sie liefert keine Gewissheit, sondern nur Wahrscheinlichkeiten.

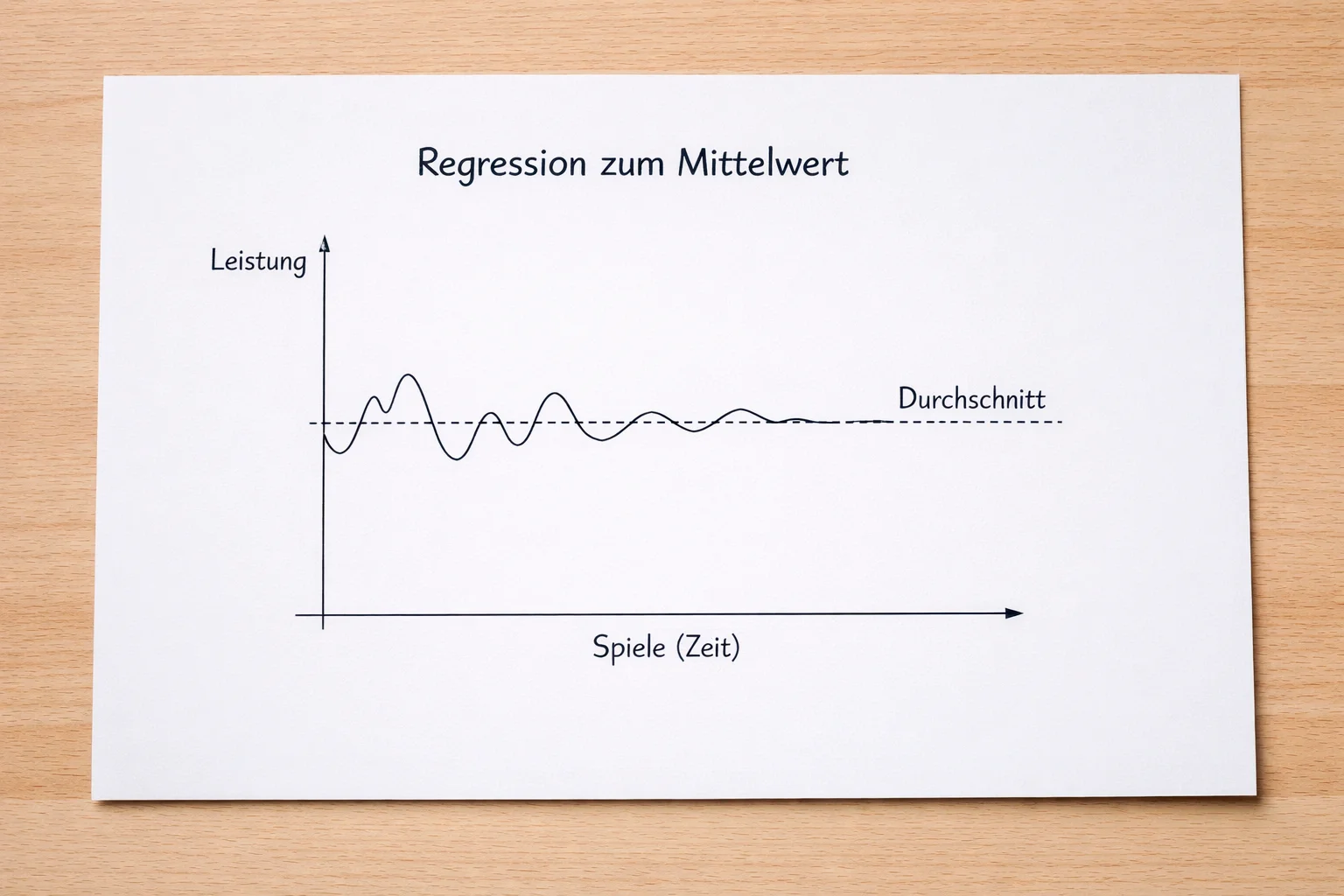

Die Regression zum Mittelwert

Die Regression zum Mittelwert ist eines der wichtigsten Konzepte für die praktische Anwendung der xG-Analyse. Sie besagt, dass extreme Werte dazu tendieren, sich im Laufe der Zeit dem Durchschnitt anzunähern.

Wenn ein Team zu Saisonbeginn deutlich mehr Tore schießt als sein xG erwarten lässt, ist die wahrscheinlichste Erklärung nicht, dass das Team außergewöhnlich gut abschließt, sondern dass es Glück hatte. Die statistische Erwartung ist, dass sich die Torausbeute im weiteren Saisonverlauf dem xG-Wert annähern wird. Dieser Effekt ist empirisch gut belegt und gilt sowohl für Über- als auch für Unterperformance.

Die praktische Relevanz für Prognosen ist erheblich. Ein Team, das nach zehn Spielen deutlich über seinem xG liegt, wird wahrscheinlich in den nächsten zehn Spielen weniger Tore schießen als in den ersten zehn. Diese Erwartung basiert nicht auf der Annahme, dass das Team schlechter wird, sondern auf der statistischen Regelmäßigkeit, dass Glückssträhnen enden.

Die Regression zum Mittelwert gilt auch für die defensive Seite. Ein Team mit wenigen Gegentoren trotz hohem xGA hat wahrscheinlich einen überragenden Torwart oder schlicht Glück gehabt. Die Erwartung ist, dass es im weiteren Verlauf mehr Gegentore kassieren wird, sofern sich die Qualität der zugelassenen Chancen nicht ändert.

Die Geschwindigkeit der Regression variiert. Manche Effekte korrigieren sich schnell, andere benötigen mehr Zeit. Die individuelle Abschlussqualität eines Spielers ist ein Bereich, in dem die Regression langsamer verläuft, weil echte Fähigkeitsunterschiede existieren. Die Teamperformance hingegen tendiert schneller zum Mittelwert, weil sie von mehr Faktoren abhängt und individuelle Ausreißer sich ausgleichen.

Korrelation und Kausalität

Die Unterscheidung zwischen Korrelation und Kausalität ist fundamental für jede statistische Analyse, wird aber häufig vernachlässigt. Zwei Größen können zusammenhängen, ohne dass die eine die andere verursacht.

Im Kontext der xG-Analyse gibt es viele Korrelationen, die keine kausalen Beziehungen darstellen. Ein hoher xG-Wert korreliert mit Siegen, aber der hohe xG verursacht den Sieg nicht direkt, sondern beide sind das Ergebnis einer überlegenen Spielweise. Die Chancenqualität und das Ergebnis haben eine gemeinsame Ursache, nämlich die Leistungsfähigkeit des Teams.

Die Verwechslung von Korrelation und Kausalität führt zu Fehlschlüssen. Wenn beobachtet wird, dass Teams mit hohem Ballbesitz tendenziell höhere xG-Werte haben, bedeutet das nicht, dass mehr Ballbesitz zu mehr Chancen führt. Es könnte auch sein, dass bessere Teams sowohl mehr Ballbesitz haben als auch mehr Chancen kreieren, ohne dass ein direkter Zusammenhang zwischen beiden besteht.

Die Suche nach kausalen Zusammenhängen erfordert mehr als die bloße Beobachtung von Korrelationen. Kontrollierte Experimente, die im Fußball praktisch unmöglich sind, wären der Goldstandard. In Ermangelung dessen müssen Analysten auf theoretische Überlegungen und sorgfältige statistische Methoden zurückgreifen, um plausible kausale Hypothesen zu entwickeln.

Die praktische Konsequenz ist Vorsicht bei kausalen Interpretationen. Wenn jemand behauptet, dass eine bestimmte Taktik zu höheren xG-Werten führt, sollte man fragen, wie diese Behauptung belegt ist. Korrelative Beobachtungen sind ein Anfang, aber sie beweisen keine Kausalität.

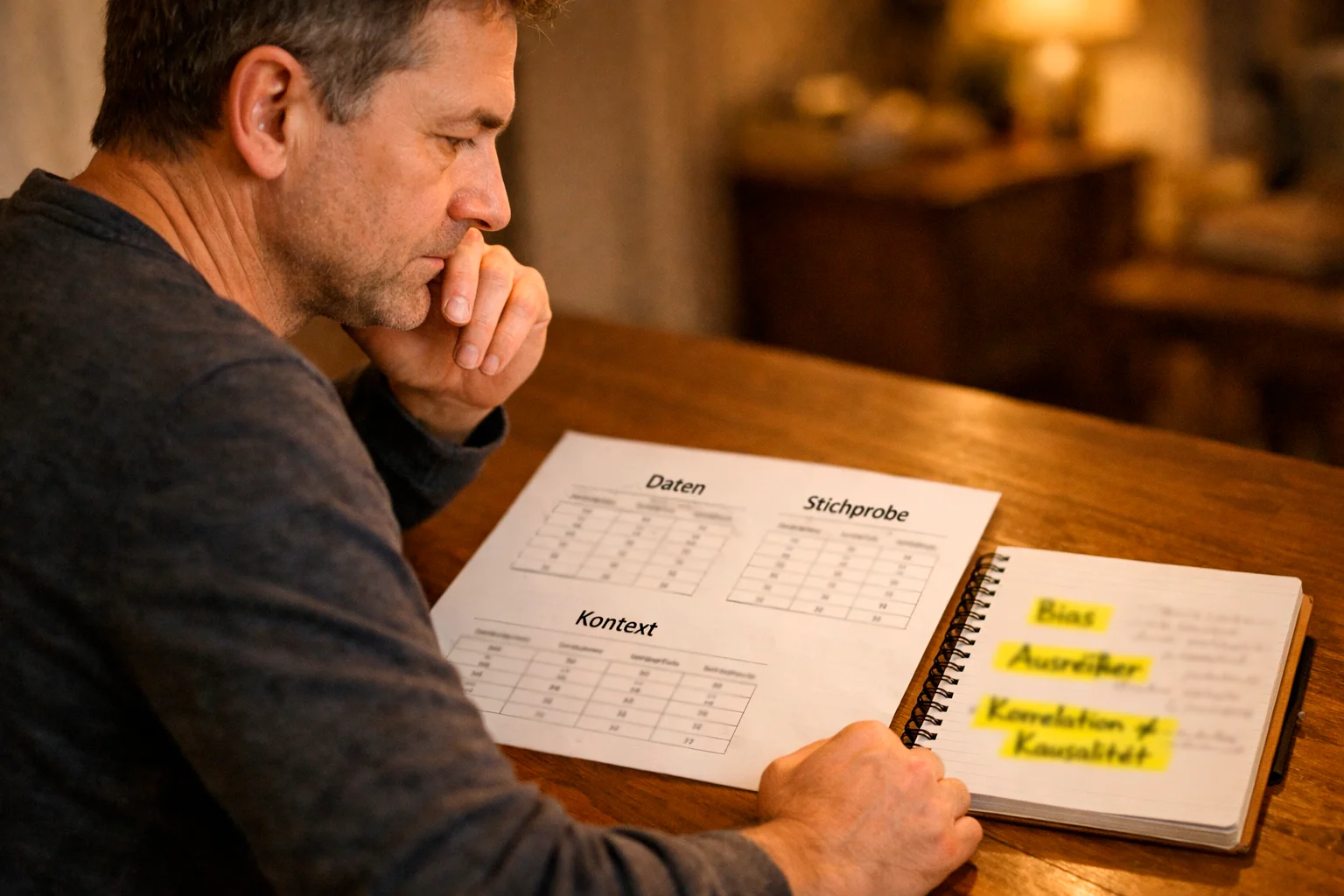

Statistische Fallstricke in der Interpretation

Die xG-Analyse bietet viele Möglichkeiten für Fehlinterpretationen, die selbst erfahrene Analysten gelegentlich unterlaufen. Die bewusste Reflexion über diese Fallstricke hilft, sie zu vermeiden.

Der Survivorship Bias ist ein klassisches Problem. Wenn wir nur die Mannschaften betrachten, die erfolgreich waren, übersehen wir jene mit ähnlichen xG-Profilen, die gescheitert sind. Die Schlussfolgerung, dass ein bestimmtes xG-Profil zum Erfolg führt, ist dann verzerrt, weil die Gegenbeispiele nicht berücksichtigt werden.

Der Confirmation Bias führt dazu, dass wir Daten suchen und interpretieren, die unsere Vorannahmen bestätigen. Wer bereits glaubt, dass ein Team überbewertet ist, wird in den xG-Daten nach Belegen für diese Einschätzung suchen und abweichende Informationen ignorieren oder herunterspielen.

Die Überinterpretation von Einzelereignissen ist ein weiterer häufiger Fehler. Ein spektakuläres Tor aus dreißig Metern hat einen niedrigen xG-Wert, aber das bedeutet nicht, dass der Torschütze Glück hatte. Es kann auch bedeuten, dass er außergewöhnlich gut schießen kann und solche Tore regelmäßig erzielt. Die statistische Erwartung gilt für den Durchschnittsspieler, nicht für jeden Einzelnen.

Die Vernachlässigung des Kontexts ist problematisch. Ein xG-Wert ohne Kenntnis der Spielumstände ist schwer zu interpretieren. War das Team in Unterzahl? Musste es einem Rückstand hinterherlaufen? Spielte der Gegner mit einer Ersatzmannschaft? All diese Faktoren beeinflussen die Aussagekraft der Daten und müssen berücksichtigt werden.

Die Integration statistischer Erkenntnisse in die Praxis

Die theoretischen Konzepte sind nur dann wertvoll, wenn sie in die praktische Analyse einfließen. Ein paar Leitlinien helfen dabei, die statistischen Erkenntnisse nutzbar zu machen.

Die Betrachtung längerer Zeiträume ist die wichtigste Regel. Wer xG-Werte für Prognosen nutzen möchte, sollte mindestens zehn bis fünfzehn Spiele als Grundlage nehmen, besser noch eine halbe oder ganze Saison. Kurzfristige Schwankungen sind zu stark von Zufall beeinflusst, um verlässliche Schlüsse zu erlauben.

Die Berücksichtigung der Unsicherheit ist ebenfalls wichtig. Jeder xG-Wert ist eine Schätzung mit einer Fehlermarge, und diese Unsicherheit sollte in die Interpretation einfließen. Statt zu sagen, dass ein Team einen xG von 1,5 hat, wäre es ehrlicher zu sagen, dass der wahre Wert wahrscheinlich zwischen 1,2 und 1,8 liegt.

Die Kombination verschiedener Informationsquellen erhöht die Robustheit der Analyse. xG-Werte allein erzählen nicht die ganze Geschichte, und die Integration von Kontextwissen, qualitativer Beobachtung und anderen statistischen Metriken führt zu besseren Einschätzungen als die isolierte Betrachtung einer einzelnen Zahl.

Die kritische Haltung gegenüber den eigenen Schlussfolgerungen ist schließlich unverzichtbar. Wer sich seiner eigenen Fehlbarkeit bewusst ist und seine Einschätzungen regelmäßig überprüft, wird langfristig bessere Ergebnisse erzielen als jemand, der von der Unfehlbarkeit seiner Analysen überzeugt ist.

Konfidenzintervalle und ihre Bedeutung

Das Konzept des Konfidenzintervalls ist für die xG-Analyse besonders relevant, weil es die Unsicherheit quantifiziert, die jeder Schätzung innewohnt. Statt eines einzelnen Wertes erhalten wir einen Bereich, in dem der wahre Wert mit einer bestimmten Wahrscheinlichkeit liegt.

Ein Team, das in zehn Spielen einen durchschnittlichen xG von 1,8 pro Spiel erzielt hat, könnte ein 95-Prozent-Konfidenzintervall von 1,4 bis 2,2 haben. Das bedeutet, dass wir zu 95 Prozent sicher sein können, dass der wahre durchschnittliche xG des Teams in diesem Bereich liegt. Die Breite des Intervalls spiegelt die Unsicherheit wider, die mit der begrenzten Stichprobe einhergeht.

Mit zunehmender Stichprobengröße wird das Konfidenzintervall schmaler. Nach einer kompletten Saison könnte das Intervall für dasselbe Team nur noch 1,6 bis 2,0 betragen. Diese Verengung reflektiert die zunehmende Sicherheit, die größere Datenmengen bieten.

Die praktische Anwendung liegt auf der Hand: Wenn die Konfidenzintervalle zweier Teams überlappen, ist die Schlussfolgerung, dass eines besser ist als das andere, statistisch nicht gerechtfertigt. Die Unterschiede könnten auf Zufall zurückzuführen sein. Nur wenn die Intervalle klar getrennt sind, können wir mit einiger Sicherheit sagen, dass ein echter Unterschied besteht.

Die Normalverteilung und ihre Grenzen

Die Normalverteilung, auch Gaußsche Glockenkurve genannt, ist ein statistisches Modell, das viele natürliche Phänomene gut beschreibt. Die Körpergröße von Menschen, die Messfehler in Experimenten und viele andere Größen folgen annähernd einer Normalverteilung.

Im Fußball ist die Normalverteilung für manche Anwendungen geeignet, für andere nicht. Die xG-Werte über eine Saison hinweg nähern sich oft einer Normalverteilung an, was die Anwendung standardmäßiger statistischer Tests ermöglicht. Die Tore pro Spiel hingegen folgen eher einer Poisson-Verteilung, weil sie diskret und nach unten begrenzt sind.

Die Unterscheidung ist wichtig, weil die Wahl des falschen Modells zu Fehlschlüssen führen kann. Wenn man eine Normalverteilung annimmt, wo eine Poisson-Verteilung vorliegt, unterschätzt man möglicherweise die Wahrscheinlichkeit extremer Ereignisse. Ein Team mit einem durchschnittlichen xG von 1,5 wird häufiger null Tore schießen, als eine Normalverteilung vorhersagen würde.

Die Erkenntnis für die praktische Analyse ist, dass man sich der Verteilung der Daten bewusst sein sollte. Die meisten Plattformen und Tools verwenden die richtigen Modelle im Hintergrund, aber wer die Berechnungen selbst durchführt, muss die angemessene Verteilung wählen.

Die Rolle des Zufalls im Fußball

Der Zufall spielt im Fußball eine größere Rolle, als viele Fans und Experten wahrhaben wollen. Die statistischen Konzepte helfen, diese Rolle zu verstehen und angemessen einzuordnen.

Die niedrige Torausbeute im Fußball verstärkt den Einfluss des Zufalls. In einem Basketballspiel mit 100 oder mehr Punkten pro Team gleichen sich zufällige Schwankungen weitgehend aus. In einem Fußballspiel mit zwei oder drei Toren kann ein glücklicher oder unglücklicher Moment das Ergebnis entscheiden.

Die xG-Analyse hilft, den Zufall vom Können zu trennen. Wenn ein Team trotz überlegener Chancen verliert, war wahrscheinlich Pech im Spiel. Wenn es trotz unterlegener Chancen gewinnt, hatte es wahrscheinlich Glück. Diese Erkenntnisse sind wertvoll, weil sie eine objektivere Bewertung ermöglichen als die bloße Betrachtung des Ergebnisses.

Die Akzeptanz des Zufalls ist psychologisch schwierig, aber analytisch notwendig. Menschen suchen instinktiv nach Erklärungen für Ereignisse, auch wenn diese Ereignisse teilweise zufällig sind. Die statistische Perspektive zwingt zur Demut gegenüber der Unvorhersehbarkeit des Spiels und schützt vor übertriebener Selbstsicherheit in Prognosen.

Die Frage, wie viel im Fußball Können und wie viel Zufall ist, lässt sich nicht pauschal beantworten. Über eine komplette Saison hinweg setzt sich in der Regel das bessere Team durch, was darauf hindeutet, dass Können langfristig dominiert. In einzelnen Spielen oder kurzen Serien kann der Zufall jedoch erheblichen Einfluss haben. Diese Unterscheidung zwischen kurz- und langfristiger Perspektive ist für die praktische Analyse von großer Bedeutung.

Bayesianisches Denken in der Fußballanalyse

Ein fortgeschrittenes Konzept, das zunehmend Eingang in die Fußballanalyse findet, ist das Bayesianische Denken. Es beschreibt, wie man Überzeugungen auf der Grundlage neuer Informationen aktualisiert.

Der Grundgedanke ist einfach: Wir beginnen mit einer Vorannahme über die Stärke eines Teams, basierend auf dem, was wir vor der Saison wussten. Im Laufe der Saison sammeln wir neue Informationen in Form von Spielen und xG-Werten. Diese Informationen aktualisieren unsere Einschätzung, wobei die Gewichtung von der Stichprobengröße abhängt.

Zu Saisonbeginn sollte die Vorannahme stark gewichtet werden, weil die wenigen gespielten Partien noch keine verlässliche Grundlage bieten. Ein Team, das nach zwei Spielen überragende xG-Werte zeigt, ist wahrscheinlich nicht so gut, wie diese Werte suggerieren, und wir sollten unsere Einschätzung nur moderat anpassen.

Mit fortschreitender Saison verschiebt sich die Gewichtung. Nach zwanzig Spielen sind die gesammelten Daten aussagekräftiger als die Vorannahme, und unsere Einschätzung sollte sich stärker an den beobachteten Werten orientieren. Diese dynamische Anpassung der Gewichtung ist das Wesen des Bayesianischen Ansatzes.

Die praktische Umsetzung erfordert keine komplexen Berechnungen. Die intuitive Anwendung des Prinzips, nämlich Vorannahmen schrittweise zu aktualisieren und dabei die Datenmenge zu berücksichtigen, führt bereits zu besseren Einschätzungen als die Vernachlässigung früherer Informationen oder die Übergewichtung neuer Daten.

Schlussbetrachtung

Die statistischen Grundlagen der xG-Analyse sind nicht kompliziert, aber sie erfordern Aufmerksamkeit und Sorgfalt. Die Konzepte der Wahrscheinlichkeit, der Stichprobengröße, der Varianz und der Regression zum Mittelwert sind die Werkzeuge, mit denen die Daten interpretiert werden können. Wer sie versteht, kann fundierte Schlüsse ziehen und die Fallstricke vermeiden, die andere in die Irre führen.

Die wichtigste Erkenntnis ist vielleicht, dass Statistik keine Gewissheiten liefert, sondern Wahrscheinlichkeiten. Die xG-Analyse sagt nicht voraus, was passieren wird, sondern was wahrscheinlich passieren wird. Diese Unterscheidung ist subtil, aber entscheidend. Wer sie begreift, kann die Daten als das nutzen, was sie sind: ein Werkzeug zur Verbesserung von Einschätzungen, nicht ein Orakel, das die Zukunft kennt.

Der Fußball bleibt bei aller statistischen Analyse ein Spiel voller Überraschungen. Die Zahlen können helfen, die Wahrscheinlichkeiten besser einzuschätzen, aber sie können das Unvorhersehbare nicht vorhersehen. Diese Spannung zwischen Berechenbarkeit und Unberechenbarkeit ist das Wesen des Sports, und sie macht die Beschäftigung mit ihm so faszinierend. Die Statistik ist dabei nicht der Feind der Faszination, sondern ihr Komplize.

Die Investition in das Verständnis der statistischen Grundlagen zahlt sich langfristig aus. Wer die Konzepte einmal verinnerlicht hat, kann sie auf jede neue Situation anwenden und muss nicht bei jeder Analyse von vorne beginnen. Das Fundament trägt, und auf ihm lässt sich ein immer differenzierteres Verständnis des Spiels aufbauen.

Die Kombination von statistischem Wissen und fußballerischem Verständnis ist das Ideal, dem jeder Analyst zustreben sollte. Weder die trockene Zahlenanalyse ohne Kontextwissen noch die intuitive Einschätzung ohne statistische Fundierung führen zu optimalen Ergebnissen. Erst die Verbindung beider Perspektiven ermöglicht Einsichten, die weder allein erreichbar wären. Dieser integrative Ansatz ist anspruchsvoll, aber er ist der Mühe wert.