KI Fußball xG Analyse simuliert: Spielsimulation als Werkzeug der Prognose

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Die Vorhersage von Fußballspielen ist ein altes Unterfangen, das durch die Verfügbarkeit von xG-Daten eine neue Dimension erreicht hat. Moderne Simulationsverfahren nutzen diese Daten, um Tausende von möglichen Spielverläufen zu berechnen und daraus Wahrscheinlichkeiten für verschiedene Ausgänge abzuleiten. Das Ergebnis sind fundierte Prognosen, die über das bloße Bauchgefühl hinausgehen. Simulierte xG-Analyse bei KI Fussball xG Analyse.

Die Idee der Spielsimulation ist nicht neu. Wettanbieter und professionelle Analysten verwenden seit Jahrzehnten Modelle, um Spielwahrscheinlichkeiten zu berechnen. Was sich geändert hat, ist die Zugänglichkeit dieser Methoden. Heute kann jeder, der die Grundprinzipien versteht, eigene Simulationen durchführen und seine Einschätzungen auf eine solide Basis stellen.

Dieser Artikel erklärt, wie xG-basierte Spielsimulationen funktionieren. Er führt in die Monte-Carlo-Methode ein, stellt verfügbare Werkzeuge vor und zeigt, wie die Ergebnisse interpretiert werden sollten. Die Grenzen der Simulation werden ebenso thematisiert wie die praktische Anwendung für Wettentscheidungen. Am Ende steht ein Verständnis, das die eigene Analysefähigkeit erheblich erweitert.

Das Grundprinzip der Spielsimulation

Die Simulation eines Fußballspiels beginnt mit der Frage: Was würde passieren, wenn dieses Spiel viele Male unter identischen Bedingungen wiederholt würde? Die Antwort auf diese hypothetische Frage liefert eine Verteilung möglicher Ergebnisse, aus der sich Wahrscheinlichkeiten ableiten lassen.

Der Ausgangspunkt ist die Schätzung der erwarteten Tore für beide Teams. Diese Schätzung kann auf historischen xG-Werten basieren, auf der Stärke der Teams relativ zur Liga, oder auf einer Kombination beider Ansätze. Wichtig ist, dass die Schätzung die durchschnittliche Anzahl von Toren angibt, die jedes Team in diesem Spiel erwarten darf.

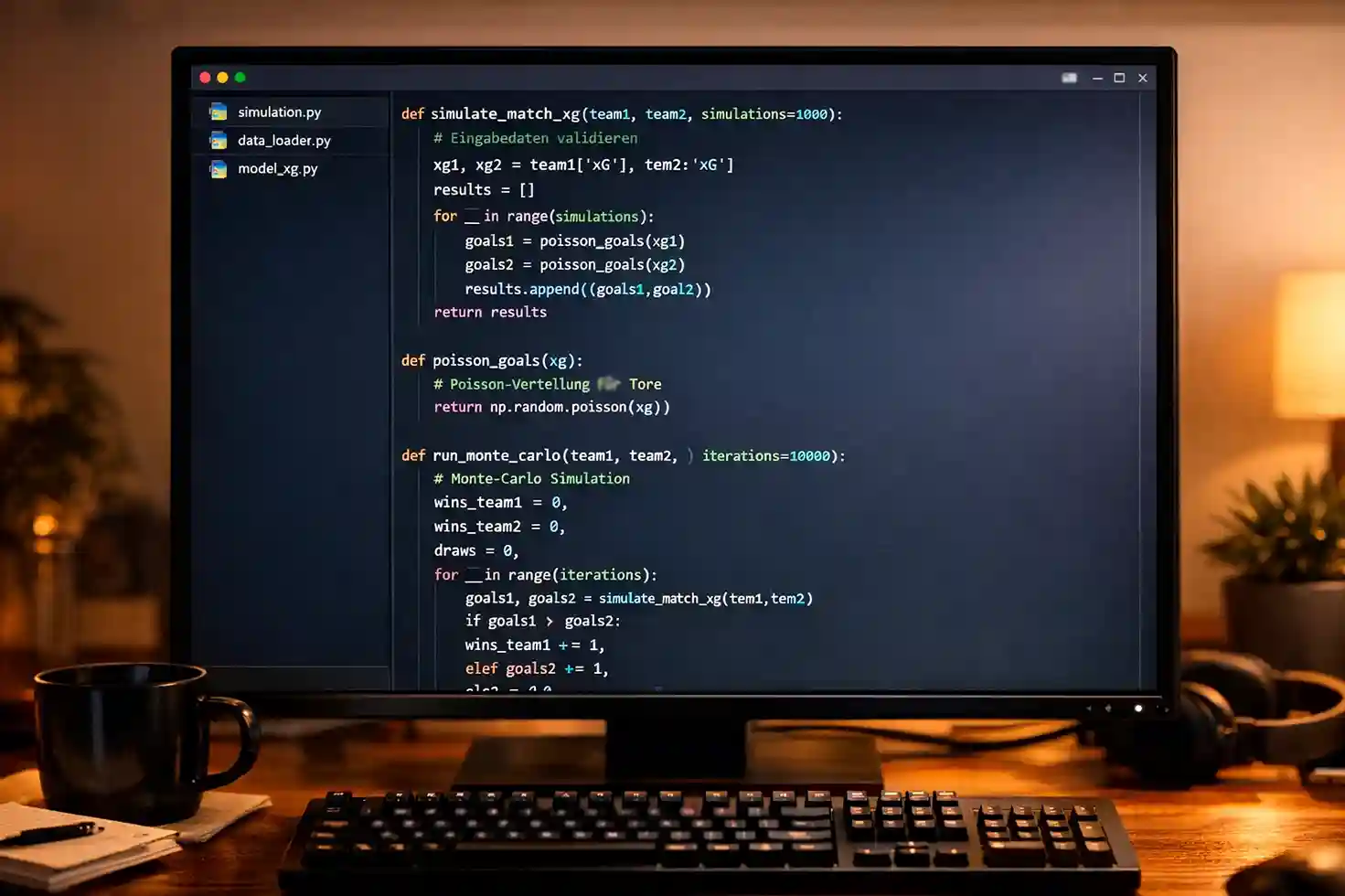

Der nächste Schritt ist die Umwandlung dieser Erwartungswerte in konkrete Spielausgänge. Hier kommt die Poisson-Verteilung ins Spiel, die beschreibt, wie wahrscheinlich verschiedene Torzahlen bei gegebenem Erwartungswert sind. Ein Team mit einem xG von 1,5 wird in etwa 22 Prozent der Fälle kein Tor schießen, in 33 Prozent ein Tor, in 25 Prozent zwei Tore, und so weiter.

Die Simulation besteht nun darin, für jedes Team eine Torzahl entsprechend dieser Verteilung zu ziehen. Das Ergebnis ist ein simuliertes Spiel, etwa ein 2:1 oder ein 0:0. Dieses einzelne Ergebnis ist nicht besonders aussagekräftig, aber wenn man den Vorgang Tausende Male wiederholt, ergibt sich ein Bild der wahrscheinlichen Verteilung von Ergebnissen.

Die Monte-Carlo-Methode erklärt

Die Monte-Carlo-Methode ist ein statistisches Verfahren, das auf wiederholter Zufallsstichprobe basiert. Der Name geht auf das berühmte Casino in Monaco zurück und spielt auf die zentrale Rolle des Zufalls in dieser Methode an.

Das Prinzip ist elegant in seiner Einfachheit. Anstatt die Wahrscheinlichkeit eines Ereignisses analytisch zu berechnen, was bei komplexen Systemen oft unmöglich ist, simuliert man das System viele Male und zählt, wie oft das Ereignis eintritt. Der Anteil der Eintritte nähert sich bei ausreichend vielen Wiederholungen der wahren Wahrscheinlichkeit an.

Für die Fußballsimulation bedeutet das: Wir simulieren das Spiel nicht einmal, sondern zehntausend Mal. In jedem Durchlauf ziehen wir zufällige Torzahlen für beide Teams entsprechend ihrer xG-Verteilungen. Am Ende zählen wir, wie oft das Heimteam gewonnen hat, wie oft das Auswärtsteam, und wie oft das Spiel unentschieden endete.

Die Präzision der Monte-Carlo-Simulation hängt von der Anzahl der Durchläufe ab. Mit tausend Simulationen erhalten wir eine grobe Schätzung, mit zehntausend eine bessere, und mit hunderttausend eine sehr genaue. In der Praxis sind zehntausend Durchläufe für die meisten Anwendungen ausreichend und auf modernen Computern in Sekundenbruchteilen berechenbar.

Die Stärke der Methode liegt in ihrer Flexibilität. Sie kann auf beliebig komplexe Modelle angewandt werden, solange man in der Lage ist, einen einzelnen Durchlauf zu simulieren. Korrelationen zwischen Ereignissen, Abhängigkeiten vom Spielstand, individuelle Spielerqualitäten, all das lässt sich in die Simulation einbauen, sofern man die entsprechenden Daten und Modelle hat.

Von der Theorie zur Praxis

Die praktische Umsetzung einer xG-basierten Simulation erfordert einige Entscheidungen, die das Ergebnis beeinflussen. Die wichtigste betrifft die Schätzung der erwarteten Tore.

Der einfachste Ansatz verwendet die durchschnittlichen xG-Werte der Teams über die letzten Spiele. Wenn das Heimteam in den letzten zehn Spielen durchschnittlich 1,6 xG pro Spiel hatte und das Auswärtsteam 1,2, verwendet man diese Werte für die Simulation. Dieser Ansatz ist transparent und leicht nachvollziehbar, ignoriert aber den Heimvorteil und die spezifische Paarung.

Ein verfeinerter Ansatz berücksichtigt den Heimvorteil, der in den meisten Ligen eine Steigerung des erwarteten xG um etwa 0,2 bis 0,3 Tore für das Heimteam bedeutet. Die Werte werden entsprechend angepasst, sodass das Heimteam in unserem Beispiel einen xG von 1,8 hat und das Auswärtsteam 1,0.

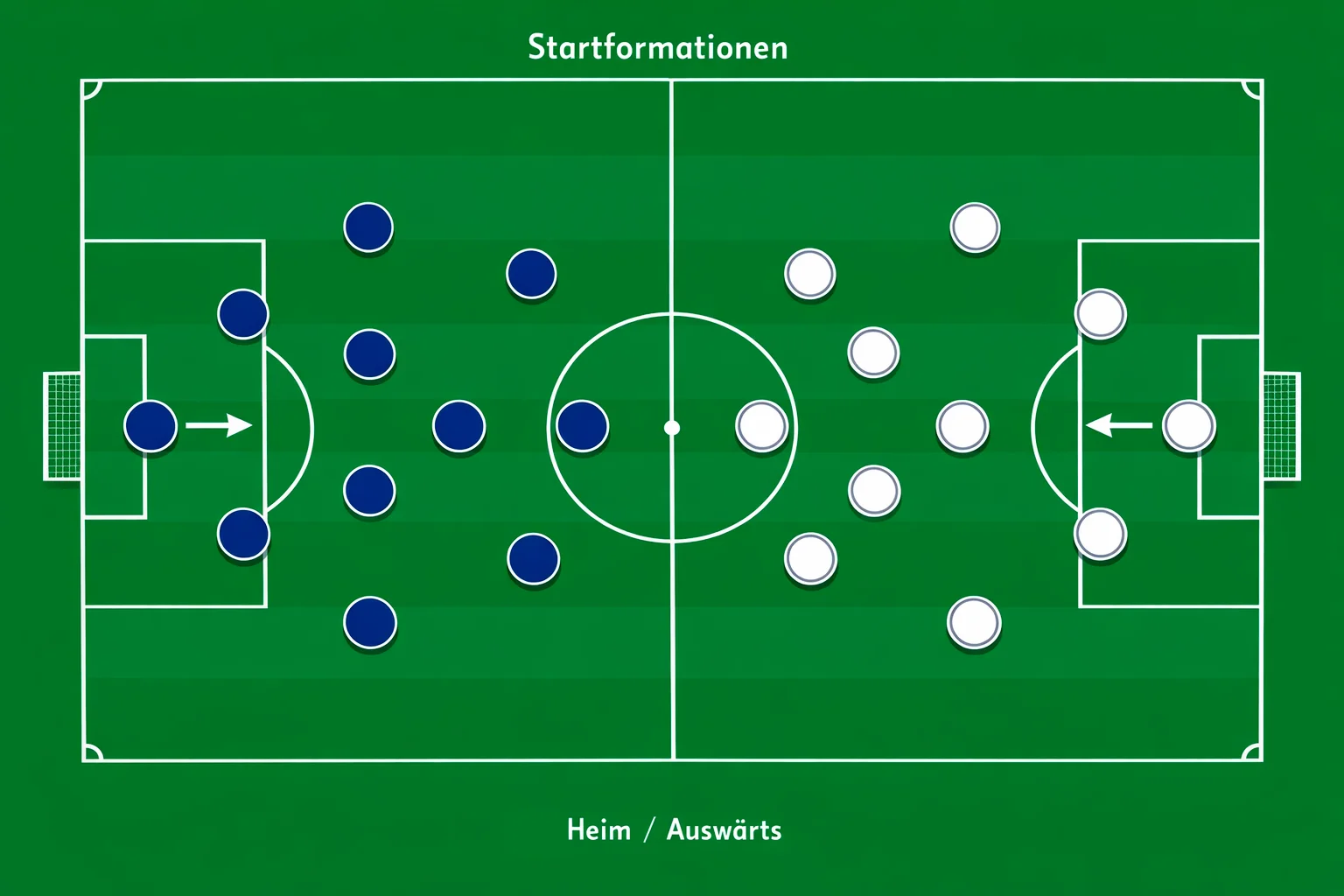

Noch ausgefeilter ist die Berücksichtigung der spezifischen Paarung. Wenn das Heimteam besonders stark gegen defensive Gegner ist und das Auswärtsteam defensiv ausgerichtet, sollte das in die Schätzung einfließen. Diese Art der Anpassung erfordert tieferes Wissen über die Teams und ihre Spielweisen, führt aber zu präziseren Prognosen.

Die Wahl des Modells ist eine Abwägung zwischen Komplexität und Nachvollziehbarkeit. Ein einfaches Modell ist leicht zu verstehen und zu überprüfen, erfasst aber möglicherweise nicht alle relevanten Faktoren. Ein komplexes Modell kann genauer sein, ist aber schwerer zu interpretieren und anfälliger für Fehler.

Interpretation der Simulationsergebnisse

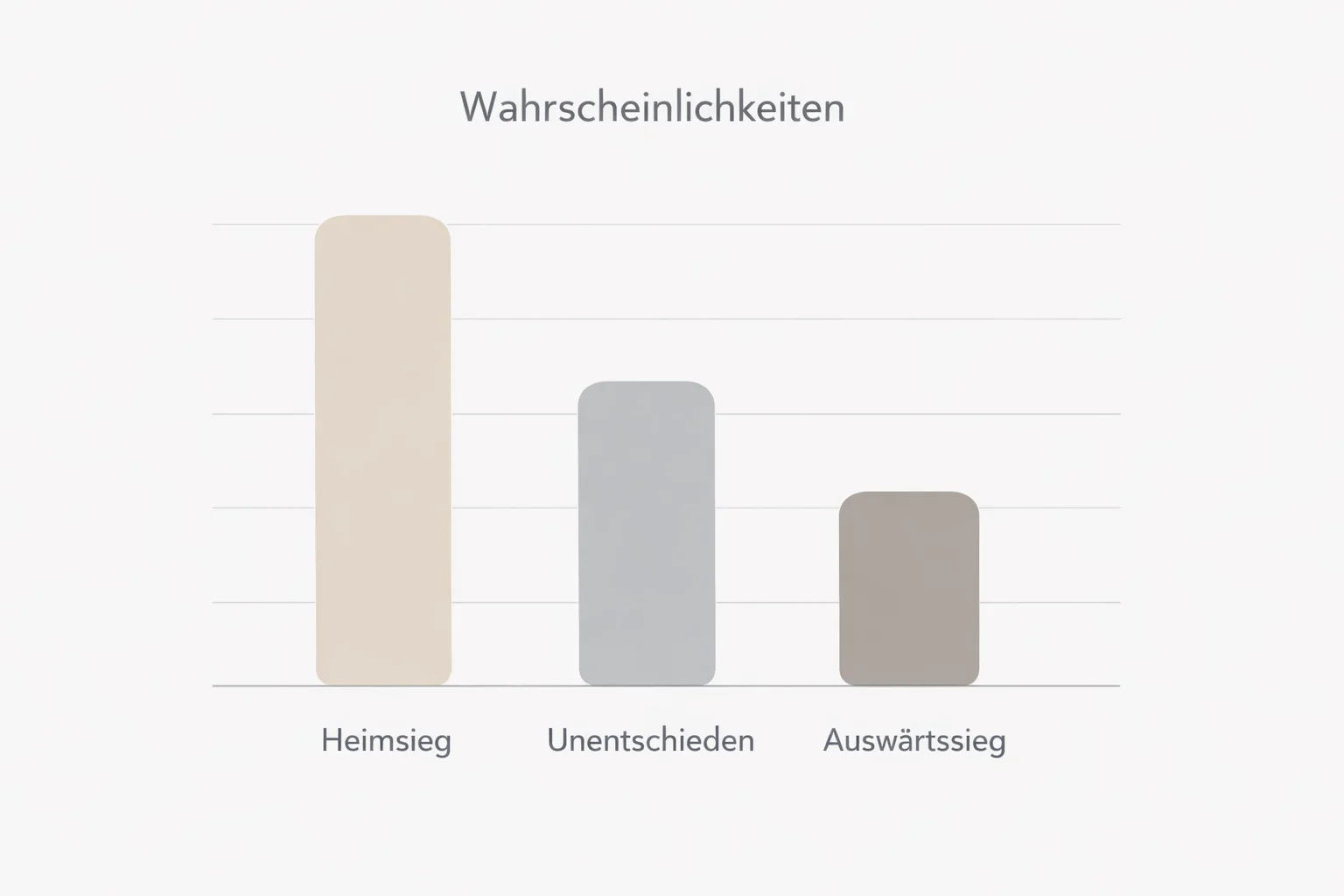

Die Ausgabe einer Monte-Carlo-Simulation ist eine Verteilung von Ergebnissen, aus der sich verschiedene Informationen ableiten lassen. Die richtige Interpretation ist entscheidend für den praktischen Nutzen.

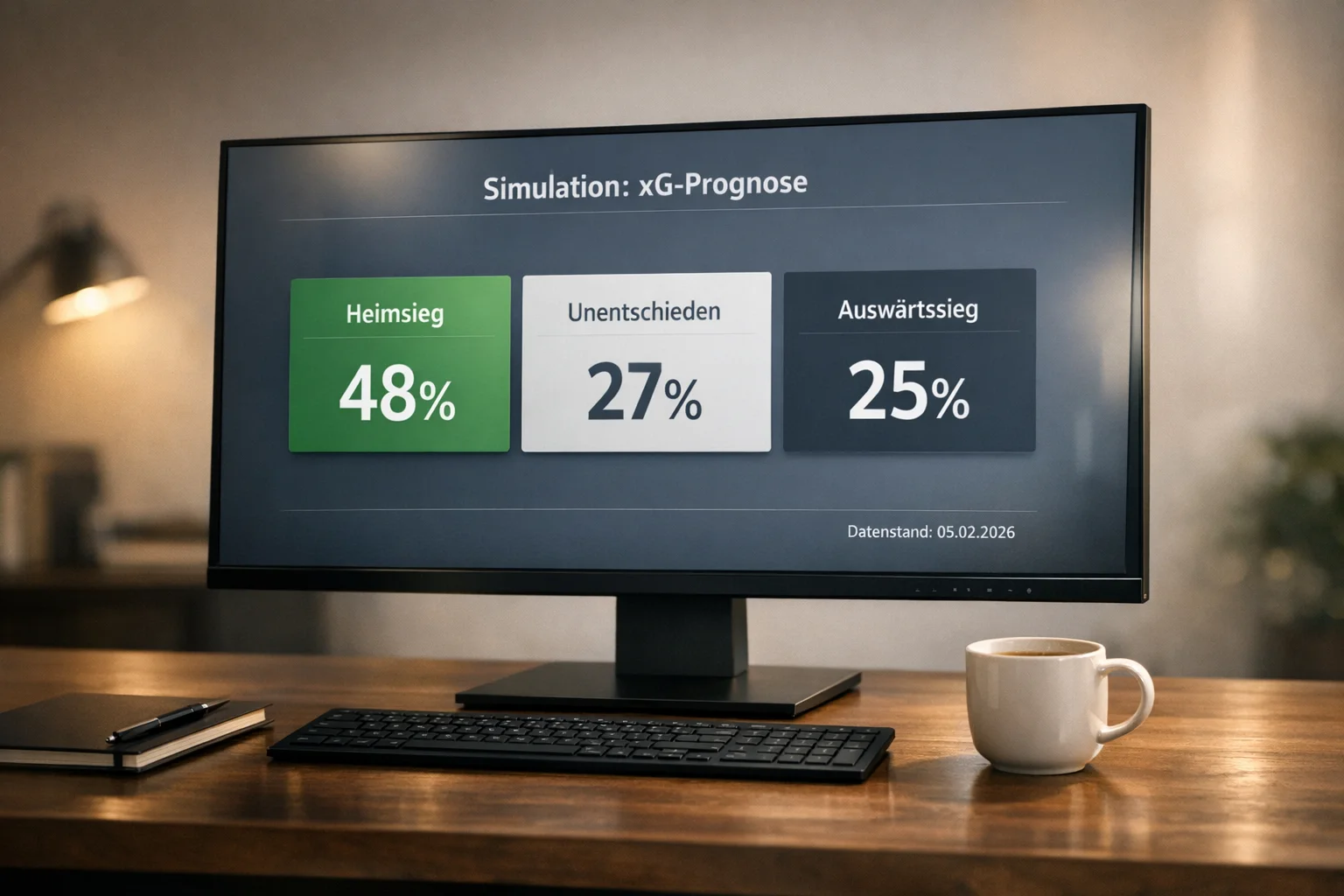

Die grundlegendste Information betrifft die Siegwahrscheinlichkeiten. Wenn in zehntausend Simulationen das Heimteam 4.500 Mal gewonnen hat, das Auswärtsteam 3.000 Mal und 2.500 Spiele unentschieden endeten, ergeben sich Wahrscheinlichkeiten von 45 Prozent, 30 Prozent und 25 Prozent. Diese Werte lassen sich direkt mit den Quoten der Wettanbieter vergleichen.

Die Verteilung der exakten Ergebnisse ist eine weitere nützliche Information. Wie wahrscheinlich ist ein 1:0, ein 2:1, ein 0:0? Diese Fragen lassen sich aus der Simulation beantworten und sind relevant für Wetten auf exakte Ergebnisse, auch wenn diese aufgrund ihrer geringen Wahrscheinlichkeiten mit Vorsicht zu genießen sind.

Die Torverteilung gibt Aufschluss über die erwartete Anzahl von Toren im Spiel. Wenn die Simulation zeigt, dass in 60 Prozent der Fälle mehr als 2,5 Tore fallen, ist das relevant für entsprechende Wetten. Diese Information ist oft stabiler als die Siegwahrscheinlichkeiten, weil sie weniger von der spezifischen Verteilung der Tore zwischen den Teams abhängt.

Die Unsicherheit der Schätzungen sollte nicht vergessen werden. Eine Siegwahrscheinlichkeit von 45 Prozent ist keine exakte Zahl, sondern eine Schätzung mit einer gewissen Fehlermarge. Diese Unsicherheit resultiert sowohl aus der statistischen Natur der Monte-Carlo-Methode als auch aus der Unsicherheit der Eingabeparameter.

Verfügbare Werkzeuge und Plattformen

Die Durchführung eigener Simulationen erfordert entweder Programmierkenntnisse oder den Zugang zu spezialisierten Tools. Beide Wege sind gangbar und haben ihre Vor- und Nachteile.

Für diejenigen mit Programmierkenntnissen ist Python die Sprache der Wahl. Die Bibliotheken NumPy und SciPy bieten alle notwendigen Funktionen für Zufallszahlengenerierung und statistische Verteilungen. Ein einfacher Simulator lässt sich in wenigen Zeilen Code schreiben und kann dann nach Belieben erweitert und angepasst werden.

Online-Rechner bieten eine niedrigschwellige Alternative. Einige Websites ermöglichen die Eingabe von erwarteten Toren und berechnen die resultierenden Wahrscheinlichkeiten. Diese Tools sind benutzerfreundlich und erfordern keine technischen Vorkenntnisse, bieten aber weniger Flexibilität als eigene Implementierungen.

Tabellenkalkulationen wie Excel oder Google Sheets können ebenfalls für einfache Simulationen verwendet werden. Die Zufallsfunktionen und statistischen Formeln dieser Programme reichen aus, um grundlegende Monte-Carlo-Simulationen durchzuführen. Die Geschwindigkeit ist geringer als bei spezialisierten Programmen, aber für gelegentliche Anwendungen ausreichend.

Die Wahl des Werkzeugs hängt von den eigenen Fähigkeiten und Bedürfnissen ab. Wer regelmäßig Simulationen durchführen möchte, sollte in das Erlernen von Python investieren. Wer nur gelegentlich eine schnelle Schätzung benötigt, kommt mit Online-Tools oder Tabellenkalkulationen aus.

Die Automatisierung ist ein wichtiger Vorteil der programmatischen Lösung. Wer ein Skript einmal geschrieben hat, kann es beliebig oft ausführen und leicht an neue Situationen anpassen. Die anfängliche Investition in das Erlernen der Programmierung zahlt sich langfristig durch Zeitersparnis und Flexibilität aus.

Die Qualität der Eingabedaten

Die Simulation steht und fällt mit der Qualität der xG-Schätzungen, die ihr zugrunde liegen. Die Frage, woher diese Schätzungen kommen und wie verlässlich sie sind, verdient besondere Aufmerksamkeit.

Der einfachste Ansatz verwendet die durchschnittlichen xG-Werte der Teams über die vergangenen Spiele. Diese Methode ist transparent und leicht umsetzbar, hat aber den Nachteil, dass sie vergangene Leistungen einfach fortschreibt. Teams entwickeln sich, Spieler wechseln, Trainer passen Taktiken an. Die Vergangenheit ist nicht immer ein guter Prädiktor für die Zukunft.

Die Gewichtung aktueller Spiele stärker als älterer ist eine Verfeinerung, die diesem Problem begegnet. Lesen Sie auch die formbasierte xG-Analyse. Ein Team, das in den letzten drei Spielen starke xG-Werte gezeigt hat, ist wahrscheinlich in besserer Form als eines, dessen gute Werte mehrere Monate zurückliegen. Die Exponentialglättung ist eine mathematische Methode, die diese intuitive Idee formalisiert.

Die Berücksichtigung der Gegnerstärke ist ein weiterer wichtiger Aspekt. Ein hoher xG-Wert gegen einen schwachen Gegner ist weniger beeindruckend als derselbe Wert gegen einen starken. Die Adjustierung nach Gegnerqualität, oft als strength of schedule bezeichnet, verbessert die Vergleichbarkeit der Werte über verschiedene Teams hinweg.

Die Integration von Informationen über die aktuelle Aufstellung kann die Prognose weiter verfeinern. Wenn bekannt ist, dass Schlüsselspieler fehlen oder ein Team in Bestbesetzung antritt, sollte das in die Schätzung einfließen. Diese Anpassung erfordert zusätzliche Daten und Einschätzungen, kann aber die Genauigkeit erheblich verbessern.

Die Grenzen der Simulation

Bei aller Leistungsfähigkeit der Simulation sind ihre Grenzen wichtig zu verstehen. Kein Modell kann die Komplexität des realen Fußballs vollständig erfassen, und die Ergebnisse sollten entsprechend eingeordnet werden.

Die fundamentalste Grenze betrifft die Qualität der Eingabedaten. Eine Simulation ist nur so gut wie die xG-Werte, auf denen sie basiert. Wenn diese Werte die wahre Stärke der Teams nicht korrekt widerspiegeln, werden auch die Simulationsergebnisse fehlerhaft sein. Die Regel garbage in, garbage out gilt auch hier.

Die Annahme konstanter Stärke über das gesamte Spiel ist eine Vereinfachung, die nicht immer zutrifft. Teams ändern ihre Taktik je nach Spielstand, Trainer wechseln Spieler ein und aus, und die Kondition lässt im Spielverlauf nach. Diese dynamischen Aspekte werden von einfachen Simulationen nicht erfasst.

Individuelle Ereignisse mit großem Einfluss entziehen sich der statistischen Vorhersage. Eine rote Karte, eine Verletzung eines Schlüsselspielers oder ein Torwartfehler können das Spiel in eine Richtung lenken, die keine Simulation vorhergesehen hätte. Diese seltenen, aber folgenreichen Ereignisse sind der Grund, warum selbst die beste Prognose nicht vor Überraschungen schützt.

Die psychologischen Faktoren sind ein weiterer blinder Fleck. Der Druck eines Derbys, die Motivation eines abstiegsbedrohten Teams oder die Nervosität in einem Pokalfinale beeinflussen die Leistung auf Weisen, die in xG-Werten nicht abgebildet sind. Die Simulation behandelt jedes Spiel gleich, aber in der Realität sind manche Spiele wichtiger als andere.

Anwendung für Wettentscheidungen

Die Verbindung zwischen Simulation und Wetten liegt auf der Hand. Die berechneten Wahrscheinlichkeiten lassen sich direkt mit den Quoten der Wettanbieter vergleichen, und Diskrepanzen können auf werthaltige Gelegenheiten hindeuten.

Das Grundprinzip ist einfach: Wenn die Simulation eine Siegwahrscheinlichkeit von 50 Prozent für das Heimteam ergibt und der Wettanbieter eine Quote von 2,5 anbietet, die einer impliziten Wahrscheinlichkeit von 40 Prozent entspricht, könnte eine Wette auf das Heimteam werthaltig sein. Die Differenz von zehn Prozentpunkten stellt den vermuteten Edge dar.

Die Realität ist komplexer, weil die eigene Schätzung mit Unsicherheit behaftet ist. Ein Edge von zehn Prozentpunkten könnte real sein, aber er könnte auch aus Fehlern in der Schätzung resultieren. Die Faustregel besagt, dass Wetten nur dann sinnvoll sind, wenn der vermutete Edge deutlich größer ist als die Unsicherheit der eigenen Schätzung.

Die langfristige Perspektive ist entscheidend. Einzelne Wetten können gewinnen oder verlieren, unabhängig davon, ob sie werthaltig waren. Erst über eine große Anzahl von Wetten zeigt sich, ob die eigene Methode profitabel ist. Die Varianz im Fußball ist hoch, und kurzfristige Ergebnisse sind kein verlässlicher Indikator für die Qualität der Analyse.

Die Disziplin, nur bei ausreichendem Edge zu wetten und die Einsätze dem Risiko anzupassen, ist mindestens so wichtig wie die Qualität der Simulation. Die beste Analyse nützt nichts, wenn sie durch undiszipliniertes Wettverhalten zunichte gemacht wird.

Das Kelly-Kriterium ist eine mathematische Formel, die den optimalen Einsatz in Abhängigkeit vom Edge und der Quote berechnet. Es maximiert das langfristige Wachstum des Kapitals unter der Annahme, dass die eigenen Wahrscheinlichkeitsschätzungen korrekt sind. In der Praxis empfiehlt es sich, konservativer zu wetten als das Kelly-Kriterium vorschlägt, um das Risiko zu reduzieren.

Die Dokumentation aller Wetten ist unverzichtbar für die Evaluation der eigenen Methode. Nur wer seine Entscheidungen und deren Ergebnisse systematisch festhält, kann beurteilen, ob der Ansatz langfristig profitabel ist oder ob Anpassungen notwendig sind.

Fortgeschrittene Simulationstechniken

Die bisher beschriebene Methode ist ein Ausgangspunkt, auf dem sich aufbauen lässt. Fortgeschrittene Techniken können die Genauigkeit der Simulation verbessern, erfordern aber auch mehr Aufwand.

Die Berücksichtigung von Korrelationen zwischen den Torzahlen beider Teams ist eine Erweiterung, die die Realität besser abbildet. In der einfachen Simulation werden die Tore der Teams unabhängig voneinander gezogen, aber in der Realität gibt es Abhängigkeiten. Wenn ein Team früh in Führung geht, ändert sich das Spielmuster, was die erwarteten Tore beider Teams beeinflusst.

Die dynamische Simulation, die den Spielverlauf in Zeitabschnitte unterteilt und die Wahrscheinlichkeiten je nach Spielstand anpasst, ist eine weitere Verfeinerung. Diese Methode erfordert mehr Rechenaufwand und detailliertere Modelle, liefert aber realistischere Ergebnisse, insbesondere für Wetten auf Spielstände zur Halbzeit oder auf die Anzahl der Tore in bestimmten Spielphasen.

Die Integration von Spielerdaten ermöglicht die Berücksichtigung individueller Stärken und Schwächen. Wenn bekannt ist, dass der beste Stürmer eines Teams verletzt fehlt, sollte das in die Simulation einfließen. Diese Anpassung erfordert Daten über den Beitrag einzelner Spieler zum Team-xG, die nicht immer verfügbar sind.

Die Kombination mehrerer Modelle, oft als Ensemble-Methode bezeichnet, kann die Robustheit der Prognose erhöhen. Statt sich auf ein einzelnes Modell zu verlassen, werden mehrere Modelle berechnet und ihre Ergebnisse gemittelt. Diese Methode reduziert das Risiko, dass ein fehlerhaftes Modell zu systematisch falschen Prognosen führt.

Die Validierung der Simulationsergebnisse

Ein Simulationsmodell ist nur so gut wie seine nachweisliche Treffsicherheit. Die Validierung, also die Überprüfung der Vorhersagen anhand tatsächlicher Ergebnisse, ist daher ein unverzichtbarer Teil des Prozesses.

Der einfachste Ansatz besteht darin, die prognostizierten Wahrscheinlichkeiten mit den tatsächlichen Häufigkeiten zu vergleichen. Wenn das Modell vorhersagt, dass Heimsiege mit einer Wahrscheinlichkeit von 50 Prozent eintreten, sollten in einer großen Stichprobe ungefähr 50 Prozent der Spiele tatsächlich mit einem Heimsieg enden. Systematische Abweichungen deuten auf Fehler im Modell hin.

Die Kalibrierung ist der Fachbegriff für diese Eigenschaft. Ein gut kalibriertes Modell ist nicht notwendigerweise das genaueste, aber seine Wahrscheinlichkeitsangaben entsprechen der Realität. Wenn es 70 Prozent Wahrscheinlichkeit für ein Ereignis angibt, tritt dieses Ereignis tatsächlich in etwa 70 Prozent der Fälle ein.

Der Brier-Score ist eine Kennzahl, die sowohl Kalibrierung als auch Trennschärfe berücksichtigt. Er misst den durchschnittlichen quadratischen Fehler der Wahrscheinlichkeitsvorhersagen und ermöglicht den Vergleich verschiedener Modelle. Je niedriger der Brier-Score, desto besser das Modell.

Die Rückwärtsvalidierung an historischen Daten ist eine Methode, um die Modellqualität zu testen, bevor man echte Entscheidungen trifft. Man wendet das Modell auf vergangene Saisons an und prüft, wie gut es die tatsächlichen Ergebnisse vorhergesagt hätte. Diese Übung ist lehrreich und hilft, die Stärken und Schwächen des Modells zu verstehen.

Der Vergleich mit Wettquoten

Die von der Simulation berechneten Wahrscheinlichkeiten lassen sich direkt mit den Quoten der Wettanbieter vergleichen. Dieser Vergleich ist aufschlussreich, weil die Quoten die aggregierte Einschätzung des Marktes widerspiegeln.

Die Umrechnung von Quoten in Wahrscheinlichkeiten ist einfach: Eine Quote von 2,0 entspricht einer impliziten Wahrscheinlichkeit von 50 Prozent, eine Quote von 3,0 einer Wahrscheinlichkeit von etwa 33 Prozent. Die Summe der impliziten Wahrscheinlichkeiten übersteigt typischerweise 100 Prozent, weil der Wettanbieter eine Marge einbehält.

Wenn die eigene Simulation höhere Wahrscheinlichkeiten für ein Ereignis ergibt als die Wettquoten implizieren, könnte eine werthaltige Wettgelegenheit vorliegen. Die Differenz zwischen der eigenen Schätzung und der Marktschätzung stellt den potenziellen Edge dar.

Die Vorsicht ist angebracht, weil der Markt in der Regel gut informiert ist. Die Wettanbieter beschäftigen eigene Analysten und verfügen über umfangreiche Daten. Wenn die eigene Einschätzung stark vom Markt abweicht, sollte man zunächst prüfen, ob die eigene Analyse einen Fehler enthält, bevor man auf den vermeintlichen Edge setzt.

Die systematische Dokumentation der eigenen Prognosen und der Markquoten ermöglicht eine nachträgliche Analyse der Treffsicherheit. Über die Zeit wird deutlich, ob die eigenen Einschätzungen tatsächlich besser sind als die des Marktes oder ob die Abweichungen auf Zufall oder Fehleinschätzungen zurückzuführen sind.

Schlussbetrachtung

Die xG-basierte Spielsimulation ist ein mächtiges Werkzeug, das die Fußballanalyse auf ein neues Niveau hebt. Sie transformiert subjektive Einschätzungen in quantifizierte Wahrscheinlichkeiten und ermöglicht einen systematischen Vergleich mit den Einschätzungen des Marktes.

Die Methode ist zugänglich und erfordert keine fortgeschrittene Mathematik. Wer die Grundprinzipien versteht, kann eigene Simulationen durchführen und seine Analysen auf eine solide Basis stellen. Die Werkzeuge sind verfügbar, die Daten sind zugänglich, und der einzige limitierende Faktor ist die Bereitschaft, sich mit der Materie auseinanderzusetzen.

Die Grenzen der Simulation sollten dabei nicht vergessen werden. Kein Modell kann die Komplexität des Fußballs vollständig erfassen, und die Ergebnisse sind Schätzungen mit inhärenter Unsicherheit. Diese Demut ist der Preis für die Präzision, die die Methode bietet, und sie ist gut investiert.

Die Zukunft wird weitere Verfeinerungen bringen. Bessere Daten, ausgeklügeltere Modelle und leistungsfähigere Rechner werden die Qualität der Simulationen weiter steigern. Doch das Grundprinzip bleibt dasselbe: die systematische Nutzung von Informationen, um bessere Entscheidungen zu treffen. Wer dieses Prinzip verinnerlicht, ist für die Zukunft der Fußballanalyse gut gerüstet.

Die praktische Anwendung erfordert Geduld und Disziplin. Die Ergebnisse einer Simulation sind keine Garantien, sondern Wahrscheinlichkeiten. Der Unterschied zwischen beiden ist fundamental und sollte nie vergessen werden. Wer mit dieser Einstellung an die Sache herangeht, wird langfristig besser abschneiden als jemand, der nach schnellen Gewinnen sucht.

Die Kombination von Simulation und Kontextwissen ist der Schlüssel zum Erfolg. Die Zahlen sind der Ausgangspunkt, aber sie müssen interpretiert und ergänzt werden. Die Kenntnis der Teams, der Spieler, der Umstände fügt den Simulationsergebnissen eine Dimension hinzu, die kein Algorithmus allein liefern kann. Diese Synthese aus Daten und Urteilsvermögen ist das, was einen guten Analysten von einem bloßen Rechner unterscheidet.